Teramo, Abruzzo. È da poco iniziato il 2025 quando Michele Cantiello, ricercatore dell’Istituto nazionale di astrofisica, riceve un’email alquanto singolare. La presente lettera – recita l’email – è un invito a partecipare al worhshop che si terrà presso l’International Space Science Institute (Issi) di Berna, in Svizzera, dal 24 al 28 marzo 2025, sul tema: “Cosa si nasconde sotto il cofano? Verso un consenso sul valore locale della costante di Hubble”. L’invito a un workshop scientifico internazionale non è certo insolito. Da astrofisico affermato, ne riceve parecchi. Manca però la consueta richiesta di preparare una presentazione su un determinato argomento. Al contrario, la missiva fa riferimento a lunghe discussioni collettive e lavoro collaborativo su un articolo di ricerca. «Quando ho ricevuto l’invito, mi aspettavo qualcosa di molto più classico», ricorda Cantiello. «Invece, è stato uno dei meeting più proficui a cui io abbia partecipato. Un approccio completamente diverso dal solito congresso, in cui faccio la mia presentazione, ci sono delle domande, poi mi siedo».

L’argomento in questione è l’annosa disputa sulla costante di Hubble, il valore che determina la velocità di espansione dell’universo. Porta il nome di Edwin Hubble, astronomo statunitense spesso celebrato come il primo ad aver messo in relazione la velocità con cui le galassie si stanno allontanando da noi e la loro distanza. Più lontane sono, più velocemente si allontanano, a riprova che il cosmo non è statico, con buona pace dello Zeitgeist dell’epoca, ma in continua espansione. Era il 1929. A onor della cronaca, con altrettanto rigore ma molto meno clamore, il collega belga Georges Lemaître aveva avanzato la stessa idea già un paio d’anni prima, inquadrando la corrispondenza tra velocità di recessione e distanza delle galassie all’interno di un cosmo che si espande, soluzione che peraltro saltava fuori dalle equazioni della relatività generale pubblicata recentemente da Albert Einstein.

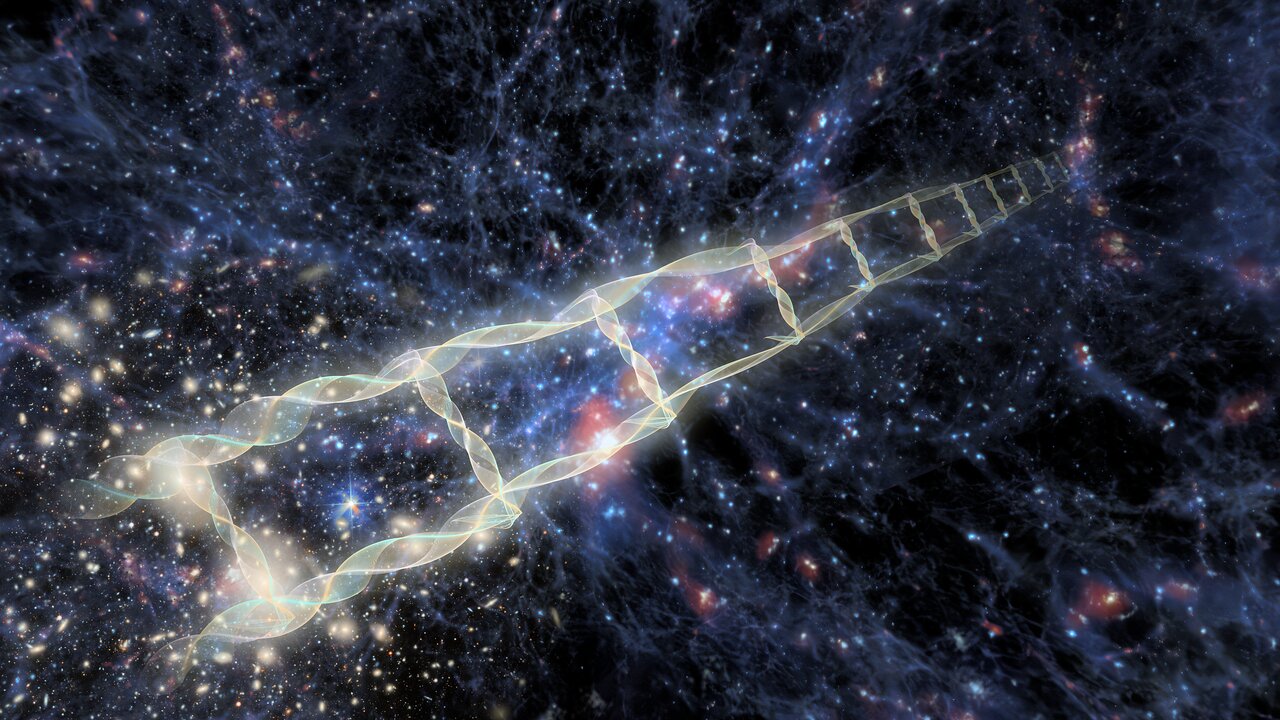

Illustrazione dell’espansione cosmica: Crediti: figura adattata da Martin Kornmesser, Luis Calcada, Nasa, Esa/Hubble

Accordi e disaccordi

La stima di Hubble, basata sulle osservazioni sue e dei colleghi Vesto Slipher e Milton Humason realizzate all’osservatorio di Mount Wilson, in California, si aggirava intorno ai 500 km/s per megaparsec – un’unità curiosa che essenzialmente misura il tasso di espansione (in km/s) per unità di lunghezza (il megaparsec utilizzato in astronomia, corrispondente a poco più di tre milioni di anni luce). Il campione di Hubble non andava molto lontano, con una ventina di galassie distanti al più sei milioni e mezzo di anni luce da noi: scala su cui le velocità risentono non solo dell’espansione generale ma anche dei moti locali, o peculiari, delle galassie stesse.

Nel corso del secolo successivo, grazie a osservazioni sempre più precise di galassie sempre più lontane, la stima di H0 – così viene abbreviata la famosa costante – è andata gradualmente decrescendo, con un periodo prolungato di oscillazioni tra 50 e 100 km/s per megaparsec, per poi assestarsi intorno ai 70 km/s per megaparsec all’inizio degli anni 2000. La precisione di queste stime, di contro, è andata aumentando, così tanto da far emergere una discrepanza tra i valori trovati utilizzando diversi metodi. Discrepanza che un tempo si celava discretamente dietro le barre d’errore e che invece da circa un decennio grida “tensione” a squarciagola. Già, nella comunità astrofisica si parla di tensione sulla costante di Hubble.

«La cosmologia ha un modello meraviglioso, il modello Lambda Cold Dark Matter (Lambda-Cdm), che spiega tutto, dall’inizio dell’universo fino alla sua evoluzione e composizione, con un successo strepitoso», afferma Licia Verde, cosmologa all’Università di Barcellona, in Spagna. «Dipende da sei parametri che ormai sono misurati con precisione dell’un per cento, e fra questi la costante di Hubble è l’unico che si può misurare in due modi completamente diversi: se lo si misura come un parametro globale del modello, quindi dalle immagini dell’universo primordiale, il fondo cosmico a microonde, si ottiene un numero. Però si può anche misurare in modo più diretto, facendo quello che faceva Hubble stesso in persona: distanze, redshift e misurare la velocità di espansione dell’universo».

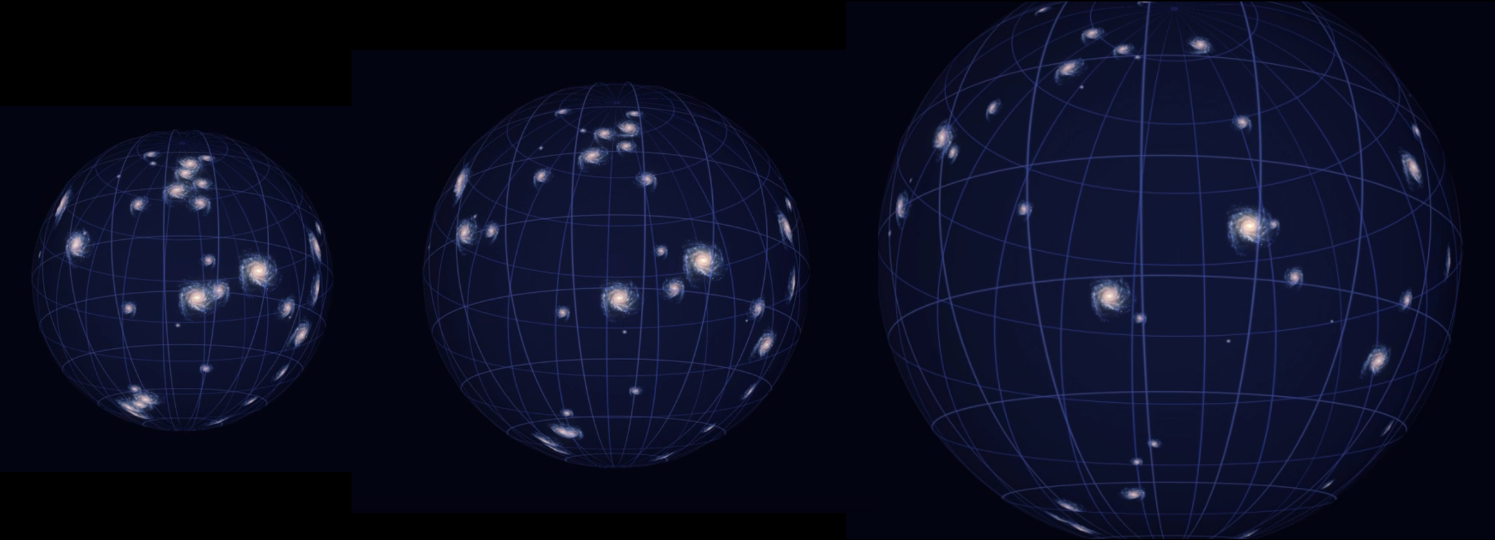

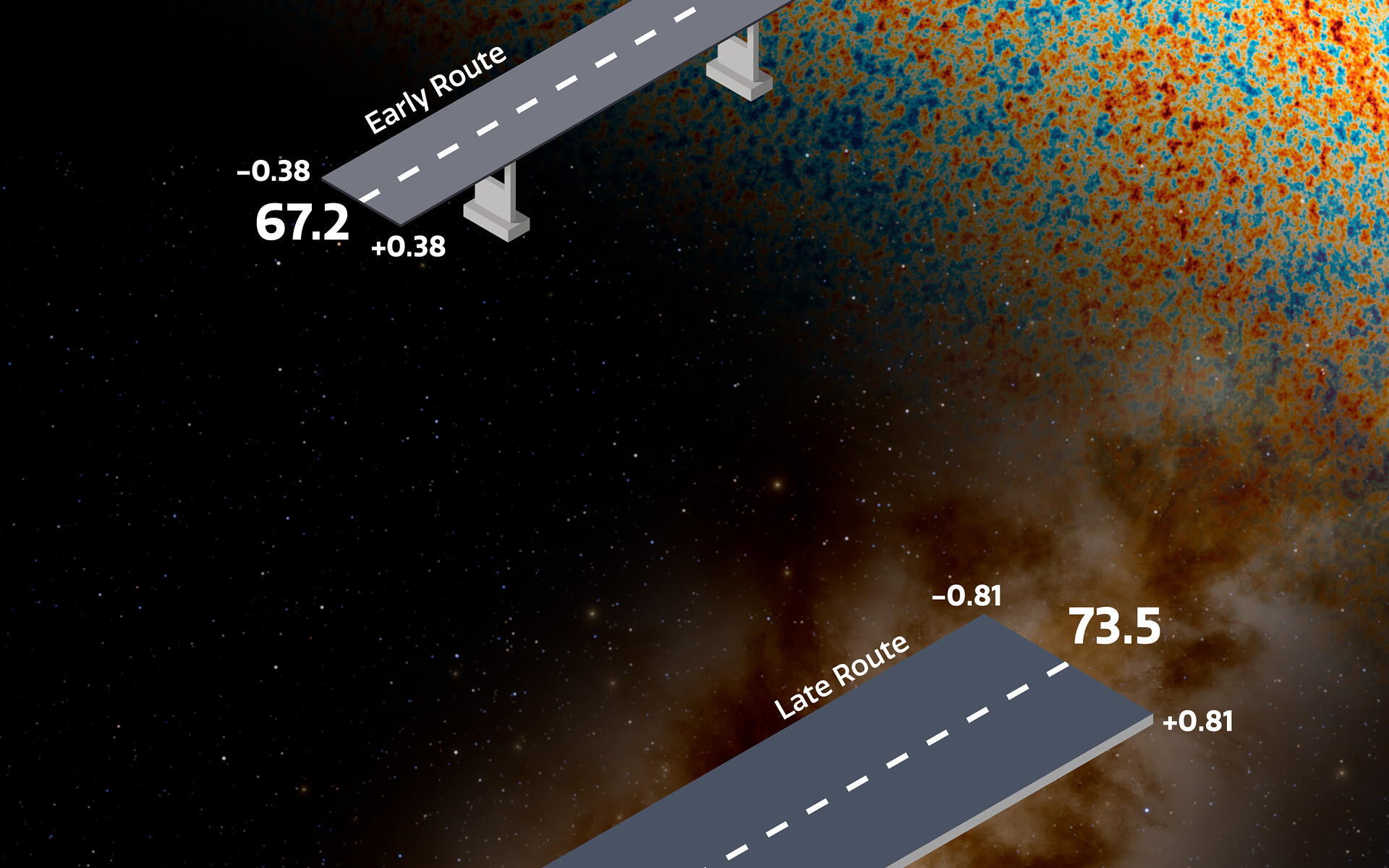

Stando alle osservazioni del satellite Planck, che ha scansionato la radiazione cosmica di fondo, la luce più antica dell’universo, risalente a circa 380mila anni dopo il Big Bang, la costante di Hubble ammonterebbe a soli 67 km/s per megaparsec. La stessa quantità, risalente ai primordi del cosmo, si può leggere anche in epoche successive, cercando le cosiddette oscillazioni barioniche nella distribuzione su grande scala delle galassie: 68 km/s per megaparsec. Con errori di appena l’un per cento, nessuno dei due numeri sembra essere compatibile con la maggior parte delle stime ottenute usando l’altro metodo, ovvero misurando la velocità di allontanamento delle galassie nell’universo “locale”, svariati miliardi d’anni più tardi: seguendo quest’altra strada, si arriva a un valore di poco più alto, ma significativamente diverso.

La tensione nasce proprio da qui. Assumendo che il modello cosmologico, basato sull’applicazione della relatività generale all’intero universo, sia corretto, ci si aspetta che il valore della costante di Hubble calcolato in questi due modi sia lo stesso. Ma non è detto che i due metodi stiano davvero misurando la stessa quantità. «Il modello prevede che sia lo stesso», nota Stefano Casertano, astrofisico presso lo Space Telescope Science Institute di Baltimora, negli Stati Uniti. «Però un osservatore parte dal principio che i modelli devono essere verificati. Quando le misure ci dicono che il numero non è lo stesso di quello che il modello ci direbbe, allora sappiamo che c’è un problema».

Illustrazione dei due metodi per stimare la costante di Hubble, quello basato su osservazioni dell’universo primordiale (in alto a destra) e quello basato su misure nell’universo locale (in basso a sinistra). Crediti: NoirLab/Nsf/Aura/J. da Silva/J. Pollard

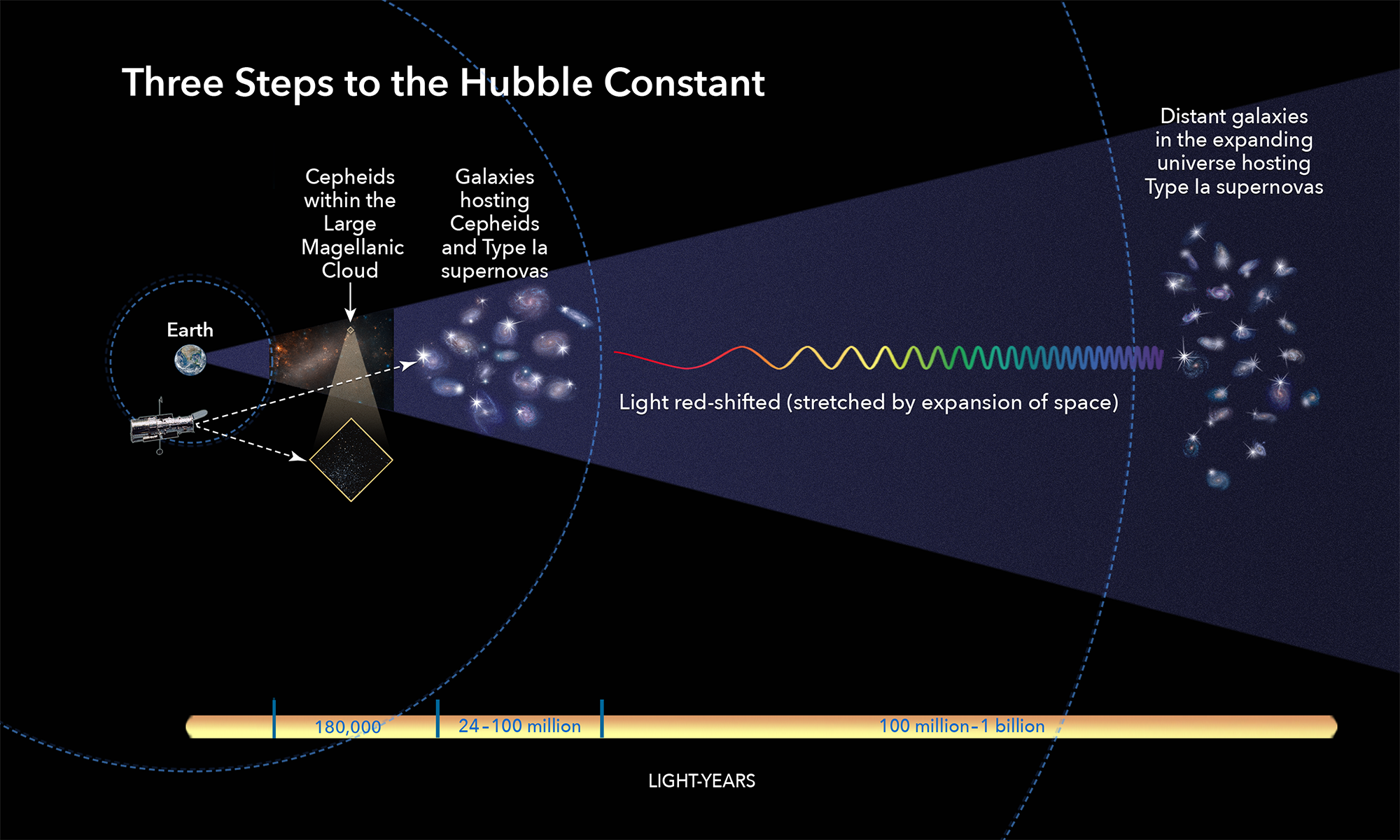

Distanze cosmiche: dalla “scala” a una rete

Misurare il tasso di espansione dell’universo non è un’impresa facile. Non tanto per le velocità di recessione, che si ricavano agilmente dagli spettri delle galassie, ma perché ha a che fare con un’altra questione notoriamente spinosa: quella della distanza in astronomia. Dalla Terra, il cosmo ci appare proiettato sulla superficie bidimensionale della volta celeste, per cui determinare quanto siano effettivamente lontane le stelle e galassie che illuminano il firmamento è tutt’altro che banale. Tradizionalmente, si procede in sequenza, incastrando tre metodi, uno dopo l’altro, per costruire una scala delle distanze. Il primo gradino di questa scala è geometrico: misurare la distanza di un corpo celeste indipendentemente dalla sua luminosità. Si applica alle sorgenti a noi più prossime, nella Via Lattea e in poche altre galassie, per gettare una sorta di “àncora” e passare così al secondo gradino: calibrare la distanza delle galassie nel vicinato cosmico. Qui, oltre ad astri simili a quelli di cui si conosce la distanza geometricamente, si cercano anche altre sorgenti o “indicatori” la cui luminosità mostra una certa regolarità: queste si possono poi osservare anche in galassie più distanti per calibrare il terzo e ultimo gradino, inoltrandosi ancora più lontano, laddove i moti peculiari non sono più rilevanti e le velocità misurano puramente l’espansione cosmica.

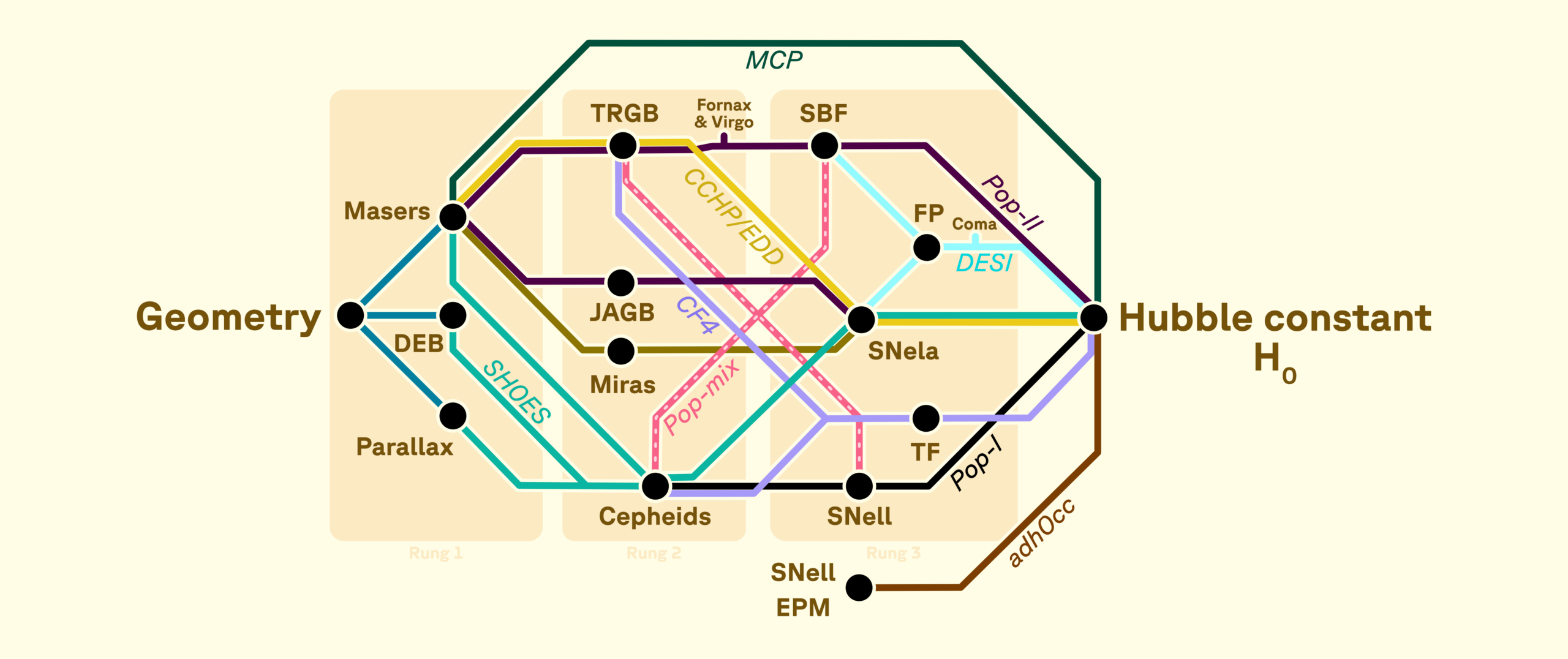

«Ognuna di queste misure è composta di tanti elementi, ciascuno dei quali deve essere verificato» sottolinea Casertano. «Negli ultimi tre, quattro anni, la comunità globale ha sviluppato un numero sufficiente di metodi diversi per ciascun elemento per poter fare dei confronti interni. Siamo arrivati al punto in cui ci sono abbastanza elementi da creare una rete: ogni elemento è indipendente, però si rafforzano a vicenda, oppure si verificano a vicenda. Così ci siamo riuniti per mettere tutte le carte in tavola e vedere come si combinano tutti i pezzi, quanto sono dipendenti l’uno dall’altro, e farlo in modo statisticamente rigoroso».

Ed eccoci a Berna, fine marzo del 2025. L’email ricevuta da Cantiello è stata recapitata a una trentina di altre colleghe e colleghi in tutto il mondo. Dagli Stati Uniti e dal Cile, dall’Australia e dal Bangladesh, dall’India e un po’ da tutta Europa, esperte ed esperti dei metodi più disparati si ritrovano nella capitale svizzera per trascorrere cinque giorni all’Issi e cercare di mettersi d’accordo sulla costante della discordia. È qui che Casertano, Verde e gli altri organizzatori del workshop – tra cui anche il premio Nobel Adam Riess – li hanno invitati a confrontarsi, a un passo dalla stazione centrale e solo una decina di minuti a piedi dallo storico edificio dell’ufficio brevetti, all’angolo tra la Speichergasse e la Genfergasse, dove Einstein aveva lavorato nei primissimi anni del Novecento, sviluppando alcuni dei suoi lavori più celebri pubblicati nell’annus mirabilis 1905, tra cui la teoria della relatività ristretta, preludio a quella generale che avrebbe permesso di affrontare, finalmente, la fisica dell’universo sulle scale più grandi.

Secondo Casertano, per avere davvero un impatto e produrre un risultato innovativo come comunità scientifica, anziché un’altra analisi simile a quelle già fatte, bisogna mettere insieme le persone, convocando tutti i gruppi coinvolti in queste ricerche. «E così abbiamo fatto», ribadisce il ricercatore. «Abbiamo invitato i rappresentanti di tutti i gruppi che lavorano sulle misure locali di H0. Soltanto un gruppo non ha mandato rappresentanti. Abbiamo provato in tutti i modi a convincerli, ma alla fine non potevano».

Un, due, tre… stella

La riunione scientifica ha inizio con la presentazione, uno per uno, di tutti gli indicatori usati per i tre gradini della canonica scala delle distanze. Partendo dal primo gradino, quello dei metodi geometrici: c’è la parallasse, una semplice relazione di trigonometria che necessita però di misure sopraffine delle posizioni stellari, come quelle del catalogo di quasi due miliardi di stelle stilato dal satellite Gaia. Ma ci sono anche sistemi di stelle binarie che, dalla nostra prospettiva, si eclissano a vicenda, oppure una particolare emissione (megamaser) da parte delle molecole d’acqua al centro delle galassie, osservata nelle onde radio.

«Ricordo che, nei primi giorni, ogni gruppo ha spiegato pro e contro dell’uso di ogni indicatore», racconta Teresa Sicignano, studentessa di dottorato presso la Scuola Superiore Meridionale a Napoli, associata all’Inaf e attualmente borsista allo European Southern Observatory (Eso) a Garching, vicino Monaco di Baviera. Nella sua ricerca di dottorato, si occupa di cefeidi, un particolare tipo di stelle variabili usate per calibrare il secondo gradino della fatidica scala. Ciò che l’ha colpita sopra ogni cosa è la trasparenza con cui ciascun gruppo ha illustrato le dipendenze del proprio metodo dagli altri. «Quando poi è stato disponibile il software ed è stato utilizzato, si è capito quali sono le misure dipendenti e quelle indipendenti, e si è potuti arrivare alla definizione di network».

Le cefeidi classiche sono state tra i primi indicatori di distanza usati per ponderare le dimensioni del cosmo, grazie all’analisi e intuizione dell’astronoma Henrietta Swan Leavitt, pubblicate in un articolo del 1912 che dà credito al suo lavoro, pur portando la firma del suo supervisore, Edward Pickering. Di lì a poco, nel 1924, lo stesso Hubble avrebbe sfruttato questo metodo: osservando una stella cefeide in quella che allora era nota come la “grande nebulosa di Andromeda”, dimostrò che si tratta in realtà di un’intera galassia al di là della Via Lattea e diede origine all’astronomia extragalattica. «La caratteristica principale è che sono stelle pulsanti: dato un certo periodo di tempo, la loro luminosità cambia» precisa Sicignano. E non solo: come dimostrò Leavitt, le più brillanti variano più lentamente. «Per questo vengono chiamate candele standard», aggiunge la dottoranda, che propone un esempio pratico: una candela, di cui conosciamo la quantità di luce e calore emessa. Se la spostiamo e riceviamo meno luce, meno calore, questo ci aiuta a stabilire quanto la candela sia lontana. Chiaramente nell’universo non possiamo spostare le stelle, ma il concetto è lo stesso. «Una volta che conosciamo la luminosità di questi oggetti a una data distanza, quando li andiamo a riconoscere in corpi celesti più distanti, sappiamo qual è la luminosità che ci aspettiamo e possiamo ricavare la distanza».

Alla base di tutto, dunque, c’è la calibrazione: conoscere la quantità di luce emessa dalla candela. Per calibrare le cefeidi, oggi si usano le misure di parallasse ottenute con Gaia. «La luminosità di una cefeide dipende dal suo periodo», rimarca Casertano, «quindi per una cefeide standard con un periodo di dieci giorni, le parallassi di Gaia ci dicono quanto è brillante perché ci dicono quanto è lontana esattamente, quindi ci danno il punto di partenza. La calibrano». Un po’ come tarare una bilancia. «Poi si va a cercare un’altra cefeide, con lo stesso periodo di dieci giorni, ma in una galassia lontana, e così sappiamo quanto è lontana la galassia».

Illustrazione della tradizionale “scala” delle distanze: le cefeidi, la cui distanza è calibrata con la misura della parallasse, vengono usate a loro volta per calibrare galassie che ospitano esplosioni di supernova. Crediti: Nasa, Esa, A. Feild (Stsci)

Le cefeidi sono indicatori di distanza intermedi: essendo molto luminose, permettono di sondare distanze molto più grandi di quanto non sia possibile con i soli metodi geometrici, grazie alle osservazioni ultra-trentennali del telescopio spaziale Hubble. Ma non sono le uniche. «Un altro metodo importante è quello della punta del ramo delle giganti rosse», prosegue Casertano. «Nelle regioni esterne di una galassia, dove non ci sono stelle giovani, c’è una luminosità massima delle giganti rosse oltre la quale se ne trovano molte, molte di meno. È un effetto dell’evoluzione stellare. Bisogna osservare tante stelle per trovare questo scalino nella distribuzione delle luminosità che ci dice quanto è lontana la galassia, perché la luminosità dello scalino è pressoché la stessa».

Oltre ai dati di Hubble, per misurare la punta del ramo delle giganti rosse ci sono anche quelli, più recenti, del telescopio spaziale Webb: un elemento di rivoluzione, lo definisce Cantiello, perché il metodo necessita di immagini molto profonde. Si basa sul flash dell’elio, «un fenomeno fisico dell’evoluzione stellare molto ben noto, con proprietà misurabili con notevole precisione, quindi il contributo nel network è importante, come le cefeidi o le altre àncore», rammenta l’astrofisico.

L’ultimo passaggio, dalle distanze intermedie a quelle più remote, comprende molteplici metodi. Il più popolare consiste in un certo tipo di supernove, chiamate Ia: hanno origine da una nana bianca che, in un sistema binario di stelle, sottrae materia alla sua compagna fino a una catastrofica esplosione. Non sono proprio candele standard, come le cefeidi, perché «non hanno tutte la stessa luminosità», chiarisce Casertano, «ma sono standardizzabili: quando si fa l’analisi della curva di luce si usano due parametri, colore e durata, e si riesce a correggerle in modo che tutte abbiano approssimativamente la stessa luminosità, con la dispersione di un decimo di magnitudine».

Anche altri tipi di supernove, quelle generate alla fine della vita di una stella massiccia, vengono usati per misurare la distanza delle galassie più lontane, e pure alcune proprietà delle galassie stesse. C’è per esempio il metodo delle fluttuazioni di brillanza superficiale (meglio noto come Sbf, dall’acronimo inglese surface brightness fluctuations) su cui lavora Cantiello insieme a un piccolo gruppo di persone nel resto del mondo, così poche che si contano sulle dita di una mano. «Si misurano fluttuazioni di brillanza superficiale per sorgenti la cui luminosità è principalmente emessa da stelle vecchie», spiega il ricercatore. «Poiché la luminosità è emessa da sorgenti discrete, le stelle appunto, per una questione statistica c’è una fluttuazione della brillanza superficiale della galassia legata ai conteggi stellari. Il segnale alla base della fluttuazione statistica che misuriamo dipende solo dalle proprietà delle popolazioni stellari nella galassia, oltre che dalla distanza». Il trucco, come negli altri casi, è la calibrazione. «Una volta misurata e calibrata, cioè vincolata la dipendenza di questa fluttuazione dalle proprietà della popolazione stellare, abbiamo una quantità che ci permette di misurare con precisione del cinque percento la distanza di galassie entro 500 milioni di anni luce con Hubble. Con Webb speriamo di arrivare a un miliardo di anni luce».

In cerca di un consenso

L’invito a Berna, pur nella sua vaghezza, menzionava una cosa importante: la ricerca di consenso. «Per me la discussione più interessante di tutte è stata il primo giorno, quando abbiamo discusso che cosa volesse dire il consenso», commenta Martino Romaniello, astronomo Eso a Garching, in Germania. «La conclusione che abbiamo raggiunto abbastanza in fretta è stata di decidere un metodo, quello che per opinione comune potesse portare il più vicino possibile a una misura accurata, con errori accurati: che ingredienti usare e con quali incertezze. Una volta che ci siamo messi d’accordo sul metodo, poi tutto il resto è venuto come conseguenza».

Diversamente dai congressi in cui partecipano esperti di un singolo campo, il workshop è stata un’occasione per confrontarsi su tutti i metodi esistenti, scandagliando minuzie e cavilli di ogni tecnica per la determinazione della costante di Hubble nell’universo locale. Quando è arrivato il momento di parlare di Sbf, per esempio, «abbiamo concordato quello che volevamo presentare», richiama alla memoria Cantiello: «i punti di forza e i punti deboli, gli argomenti utili alla discussione, dagli aspetti più naive a quelli più tecnici».

Per fare chiarezza tra i tanti metodi sciorinati in dettaglio, si è deciso di votare, con tanto di urne e schede segrete. Un gradino dopo l’altro, le votazioni hanno definito l’insieme di riferimento dei per misurare H0, superando la scala e adottando l’ottica di un network. Pensiamo a una rete di trasporti urbana. Se dobbiamo andare all’aeroporto, potremmo dover camminare fino a una stazione della metropolitana, prendere il treno per raggiungere la stazione ferroviaria e da lì un treno suburbano per arrivare fino all’aeroporto. Ma non è l’unica via. Se abbiamo fortuna, magari possiamo prendere quel tram che passa ogni tanto, ma proprio sotto casa, e arriva davanti alla stazione, e poi da lì proseguire in treno. Oppure prendere un passaggio in auto da un amico che ci porta fino al terminale dei bus, e da lì prendere una corriera, o ancora andare in taxi. Non importa il percorso esatto o la combinazione dei diversi mezzi di trasporto, purché non si perdano le coincidenze e si arrivi all’aeroporto in tempo per il volo desiderato.

Visione concettuale del network di distanze locali sotto forma di mappa della metropolitana, in cui ogni metodo rappresenta un stazione ed esistono molteplici percorsi per raggiungere la destinazione (la costante di Hubble, a destra). Crediti: Fabio Crameri (Issi Bern) da un originale di Richard I. Anderson

La scelta di indire una sorta di referendum sui metodi da adottare non va confusa con una fantomatica democrazia. «Spesso si sente dire che la scienza non si fa per democrazia, ed è vero», appunta Romaniello. «Tutto quello che è stato fatto lì è basato su una rigorosissima analisi statistica. È un risultato assoluto, non è l’opinione delle 36 persone presenti». Propedeutica al voto, infatti, è stata la rassegna dei metodi, per fornire a ogni partecipante la visione globale dello stato dell’arte di ciascun campo, con le sue criticità, e le risposte alle critiche. Un passaggio essenziale. «Per esempio», fa notare Verde, «come faccio io, che lavoro sul fondo cosmico a microonde e le oscillazioni barioniche, a votare su un certo tipo di supernova? Sì, conosco un po’ di letteratura, ma mi manca la visione globale. Solamente dopo che tutti erano sulla stessa pagina, abbiamo iniziato a votare».

Erano presenti esponenti di gruppi in competizione dal punto di vista scientifico e c’è stata molta discussione, a detta di Cantiello, «franca ma allo stesso tempo sempre serena». Il ricercatore confessa di essersi accorto della differenza in un altro meeting a cui ha partecipato qualche tempo dopo, nel quale la contrapposizione tra gruppi e posizioni contrastanti era molto più marcata. «È stato un ambiente davvero costruttivo dal punto di vista scientifico. E non solo per l’indicatore che conosco bene, ma anche per le cose più trasversali a ciò di cui mi occupo. Comprendere questi aspetti, che non sempre sono citati nei paper e anzi bisogna cercare nella letteratura storica, ci ha permesso di partecipare alla fase di voto. È stato paradigmatico rispetto a come dovrebbe essere fatto il lavoro scientifico: collettivo e consapevole». Alla fine il suo metodo, quello delle fluttuazioni di brillanza superficiale, ha riscosso successo alle urne. Un esito non del tutto inaspettato, ammette, anche se «il risultato di maggioranza veramente alta, di accordo intorno al fatto che questa tecnica sia considerata affidabile» ha destato un po’ di sorpresa. Dal canto suo, Casertano non ne era molto convinto. «Se qualcuno mi avesse chiesto due anni fa, prima che iniziassi a guardare in dettaglio tutti i metodi, cosa ne pensavo delle fluttuazioni di brillanza superficiale, probabilmente sarei stato uno scettico», riconosce, «ma come risultato del mio approfondimento, prima, e poi della presentazione dei colleghi, sono diventato un believer».

Un risultato comunitario

Svolte presentazioni e votazioni, raggiunto l’accordo sull’approccio da seguire, il workshop è passato alla fase operativa: computer alla mano, divisi in gruppetti, i partecipanti hanno sviluppato pezzi di software, confrontandosi sui dettagli delle misure fatte, per estrarre il tanto agognato numero. Seguendo la rosa di metodi selezionata dalla comunità, il valore della costante di Hubble risulta essere 73.50 ± 0.81 km/s per megaparsec, con un errore di poco superiore all’un per cento.

«Abbiamo discusso anche sulle varie variazioni rispetto alla baseline», puntualizza Verde. «Quindi lasciar fuori un metodo non significa lasciarlo fuori completamente». Allo scopo di esplorare la robustezza dei dati, sono state approfondite una trentina di possibili varianti votate dal gruppo, per setacciare altre tecniche o insiemi di dati che non erano finiti nel pacchetto di riferimento. C’era una regola, sulle varianti: non era permesso proporne una soltanto per raggiungere un certo risultato. «La definizione delle varianti doveva essere fatta prima di conoscere il valore di H0», insiste Casertano.

Nell’ottica del network, se si scarta un metodo, oppure se lo si applica a un set di osservazioni diverso, il risultato non dovrebbe cambiare. E così è stato: nessun metodo, singolarmente, domina il prodotto finale. Il valore della costante di Hubble varia di poco ripetendo il calcolo senza includere un indicatore o l’altro, inclusi quelli storici come le cefeidi, la punta del ramo delle giganti rosse o le supernove. Per queste ultime, in particolare, sono state considerate molteplici procedure e insiemi di dati, comprese quelle dell’unico gruppo di ricerca non presente al workshop, il cui valore di H0 parrebbe essere – caso raro tra le misure astrofisiche – in accordo con le stime cosmologiche. «Abbiamo usato tre diversi fitter per fare l’analisi della curva di luce delle supernove e ottenere la luminosità», evidenzia Casertano. «I risultati sono gli stessi».

Superato il vaglio di tutti i test immaginabili, la nuova stima della costante di Hubble vanta una precisione e coerenza interna senza precedenti, confermando ancora una volta la discrepanza con i valori dedotti dalle osservazioni dell’universo primordiale nell’ambito del modello cosmologico standard. Qualcosa non torna. «Se il modello è corretto, il parametro del modello che si chiama H0 che viene dallo studio dell’universo primordiale deve avere lo stesso valore del coefficiente tra distanza e velocità», sostiene Verde. «Se questa cosa non quadra, è come fare la prova del nove: o hai fatto male il calcolo o la moltiplicazione non è stata fatta bene. Da lì non se ne viene fuori».

Negli ultimi dieci anni, una parte della comunità si è opposta con fermezza alla discrepanza tra i due valori. «Partono dal presupposto che il modello Lambda-Cdm e le misure del fondo cosmico a microonde siano perfette, e qualunque cosa violi questa perfezione non è accettabile», chiosa Casertano. «Quelli della mia generazione», prosegue, «che hanno visto cosa è successo negli anni Ottanta e Novanta con il parametro di densità della materia, che doveva essere uguale a uno perché quello era il presupposto teorico, sanno per esperienza che quando c’è un presupposto teorico è difficile combatterlo. È difficile capire come conciliare un presupposto teorico con le misure, perché le misure possono essere sbagliate, ma anche la teoria può essere sbagliata».

I risultati di questo lavoro sono stati appena pubblicati sulla rivista Astronomy & Astrophysics. Escludendo a tutti gli effetti la possibilità che sia un singolo errore, trascurato nelle misure della distanza locale, a causare la discrepanza, il nuovo studio supporta il crescente numero di prove a favore del fatto che la tensione è reale e potrebbe indicare una nuova fisica al di là del modello cosmologico standard. «Non c’è un singolo effetto sistematico che può giustificare la differenza tra i due valori di H0», dichiara Verde. «Certo, potrebbero esserci un sacco di effetti sistematici che interessano diverse misure, e che agiscono tutti nella stessa direzione: ma a questo punto a me sembra come aggiungere epicicli. Da tutto questo network, puoi togliere un passaggio, un nodo del network, ma il risultato rimane sempre lì. L’allineamento di diversi effetti sistematici è un po’ difficile da credere. Forse i cosmologi che sono cresciuti con il fondo cosmico a microonde in testa (come me) devono ampliare l’orizzonte e prendere sul serio anche le misure astrofisiche».

L’ultima parola sulla costante di Hubble?

L’esito del workshop di Berna del 2025 non sarà certo l’ultima parola su questa disputa scientifica, che rimane tuttora aperta – un po’ come il “grande dibattito” del 1920 tra Harlow Shapley e Heber Curtis sulla natura delle nebulose a spirale, risolto solo quattro anni dopo con la determinazione della distanza dalla galassia di Andromeda a opera di Hubble. Del resto, suggerisce Sicignano, «non c’è mai stato l’obiettivo che fosse l’ultima parola: al massimo, che fosse una parola di consenso, su cui erano d’accordo tutti».

È forse proprio il consenso la pietra miliare di questo lavoro. Mettersi d’accordo su quale metodo seguire, come comunità. Qualcosa che diventa possibile quando si ha «una piattaforma neutra e congeniale ad avere una discussione costruttiva, ma collegiale e rispettosa, in cui si può parlare apertamente di tutto: di quello su cui si è d’accordo e di quello su cui non si è d’accordo», riflette Antonella Nota, direttrice esecutiva dell’Issi. Nelle sue parole, il consenso in astrofisica è questo: «solo scienza, niente politica, niente lobbying per missioni future… e scrivere tutte le conclusioni in un articolo firmato da tutti, in rigoroso ordine alfabetico – con me per ultima».

Al consenso fa da contraltare l’aver reso tutto pubblico. «Non solo l’articolo ma tutto il resto: tutti i dati, tutto il software, tutta la metodologia è disponibile a chiunque, in modo che chiunque possa rifare gli esperimenti così come sono stati fatti nell’articolo, e anche altri, che magari nell’articolo non sono stati tentati», specifica Romaniello. «Questo cambia davvero lo scenario, perché è veramente open science, come si deve fare la scienza». Un precedente importante, che è anche un monito per i prossimi lavori sul tema: «non si può più pubblicare una misura senza far vedere il software, i dati, la metodologia», auspica Verde.

Pensa al futuro anche Sicignano, soddisfatta di aver partecipato a un incontro simile nel bel mezzo del dottorato, «perché ha gettato le basi per qualcosa che si spera diventerà prassi: che il codice sia libero è indicativo del fatto che non è un lavoro chiuso, ma può continuare». Con gli strumenti di ultima generazione e le imponenti survey osservative previste per gli anni a venire, può sempre saltar fuori qualche novità, e l’opportunità di poter ridefinire la baseline è fondamentale. Chissà, forse tra qualche anno ci sarà un “consenso 2.0” sulla costante di Hubble – anche se, secondo Cantiello, non dovremmo aspettarci «grossi spoiler o risultati molto diversi». Il prossimo passo spetta ora alla comunità cosmologica – esperte ed esperti di teoria, di modelli e di dati, in particolare quelli di Planck –, «per vedere se si esce dallo stallo», conclude Nota, «o almeno se ci capisce cosa è necessario fare per uscirne». Proprio come come ai tempi di Einstein, Hubble e Lemaître.

Per saperne di più:

- Leggi su Astronomy & Astrophysics l’articolo “The Local Distance Network: A community consensus report on the measurement of the Hubble constant at ∼1% precision” di Stefano Casertano, Gagandeep Anand, Richard I. Anderson, Rachael Beaton, Anupam Bhardwaj, John P. Blakeslee, Paula Boubel, Louise Breuval, Dillon Brout, Michele Cantiello, Mauricio Cruz Reyes, Geza Csörnyei, Thomas de Jaeger, Suhail Dhawan, Eleonora Di Valentino, Lluís Galbany, Héctor Gil-Marín, Dariusz Graczyk, Caroline Huang, Joseph B. Jensen, Pierre Kervella, Bruno Leibundgut, Bastian Lengen, Siyang Li, Lucas Macri, Emre Özülker, Dominic W. Pesce, Adam Riess, Martino Romaniello, Khaled Said27, Nils Schöneberg, Dan Scolnic, Teresa Sicignano, Dorota M. Skowron, Syed A. Uddin, Licia Verde e Antonella Nota