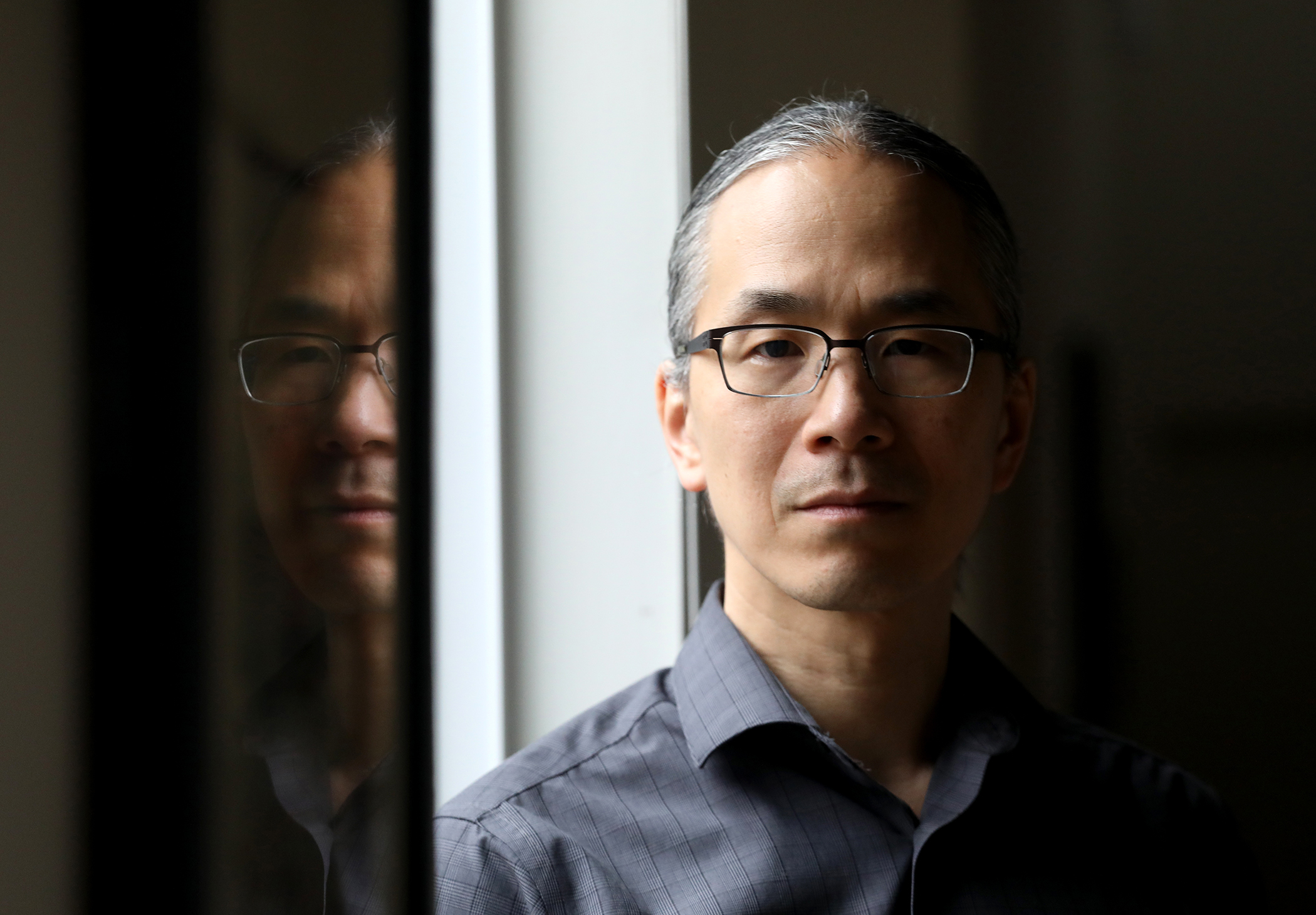

Tra gli autori contemporanei che hanno influenzato l’immaginario della fantascienza negli ultimi decenni c’è sicuramente Ted Chiang, scrittore statunitense di notevole intensità speculativa e vincitore dei maggiori premi del settore. La sua opera, contenuta per quantità – ha pubblicato solo 16 racconti e un romanzo breve – ma importante per il numero di premi, l’impatto e il riscontro di pubblico ottenuti, ha ridefinito in qualche modo il rapporto tra scienza e narrazione. Non stupisce quindi che, in occasione del Trieste Science+Fiction Festival, Chiang sia stato insignito del premio “Inaf – Event Horizon Award”, un riconoscimento alla sua opera che la commissione ha definito “sintesi rara di profondità filosofica, rigore scientifico ed eleganza letteraria”, avendo saputo portare la visione narrativa all’interno del mondo cinematografico della fantascienza.

Lo scrittore americano di fantascienza Ted Chiang. Dal suo romanzo “Storia della tua vita” è tratto il film “Arrival”. Il suo nome cinese è Chiang Feng-nan (姜峯楠). Crediti: Alan Berner

Chiang è noto al grande pubblico soprattutto per Storia della tua vita (Stories of Your Life and Others), un’antologia di racconti da cui è tratto il film del regista Denis Villeneuve Arrival, uno dei più influenti lungometraggi di fantascienza degli ultimi anni. Il racconto — come gran parte della sua produzione — affronta con straordinaria lucidità temi complessi come il rapporto tra libero arbitrio e determinismo, il ruolo del linguaggio nella percezione del tempo e il desiderio umano di prevedere il futuro. La scrittura di Chiang parte spesso da un’ipotesi scientifica o filosofica per esplorare poi le conseguenze emotive, morali e sociali.

Considerando il suo interesse verso la scienza e la tecnologia, insieme a Chiang abbiamo provato a riflettere sulle possibilità predittive del futuro e sulle implicazioni dell’idea di poter conoscere in anticipo ciò che accadrà, discutendo anche dell’impatto dell’intelligenza artificiale sulla società e sull’identità umana, sulla coscienza e il libero arbitrio. Le sue risposte confermano ancora una volta perché Ted Chiang sia da considerarsi degli autori più attuali e interessanti della fantascienza contemporanea.

Uno dei temi principali di Storia della tua vita è il conflitto tra libero arbitrio e determinismo. Le sue opere spesso parlano di conoscenza e previsione. Quali sono, secondo lei, i maggiori rischi e benefici delle tecnologie che potrebbero prevedere o influenzare il futuro?

«Non esistono tecnologie che ci consentano di prevedere gli eventi futuri. Siamo migliorati nelle previsioni del tempo, ad esempio, ma la fisica dei sistemi caotici – come l’atmosfera terrestre – impone limiti molto rigidi alla capacità di prevedere il tempo con largo anticipo. Nessuna quantità di dati raccolti o calcoli effettuati ci consentirà di fare previsioni meteorologiche un anno prima, così accurate quanto quelle che facciamo per questa settimana. La società umana non può essere più facile da modellare dell’atmosfera terrestre, perché anche il tempo che scorre influisce sulle attività umane. Anzi, la società è probabilmente più difficile da prevedere perché è reattiva: se qualcuno fa una previsione sul mercato azionario, il mercato può reagire in modo da rendere la previsione falsa. Per questo non temo l’arrivo di tecnologie predittive miracolose».

In occasione dello scorso Trieste Science+Fiction Festival, Ted Chiang ha ricevuto il premio Inaf Event Horizon. Crediti: Trieste Science+Fiction Festival

Il suo breve racconto “What’s Expected of Us”, pubblicato sulla rivista Nature, descrive un piccolo dispositivo, il “Predictor”, che mostra che le nostre azioni sono già determinate: la luce si accende prima che l’utente prema il pulsante. Pensa che accettare un universo deterministico possa liberarci dall’illusione del controllo o sarebbe per noi un peso psicologico?

«Se ipoteticamente inventassimo un dispositivo che trasmette informazioni dal futuro al passato, sorgerebbe un paradosso: cosa succede se il dispositivo ti avverte che domani accadrà qualcosa di molto spiacevole, qualcosa che potresti facilmente evitare? Non puoi evitarlo, perché ciò violerebbe la premessa secondo cui hai ricevuto informazioni dal futuro. Le soluzioni possibili sono due. Una è che, dopo l’invenzione del dispositivo, non accada più nulla di spiacevole ed evitabile: è possibile, ma improbabile. L’altra è che le persone adottino uno stato mentale molto strano. Una volta partecipai a una tavola rotonda e una partecipante suggerì che le persone assumerebbero subito un atteggiamento di accettazione buddista verso ciò che accadrà loro. È possibile e coerente con alcuni individui, ma sarebbe estremamente insolito per altri. Non credo che l’invio di informazioni dal futuro possa conciliarsi con la psicologia umana così come la intendiamo oggi».

Lei ha affermato che l’intelligenza artificiale rappresenta una sfida per l’identità umana. In che modo incide sugli aspetti essenziali della nostra natura?

«Io penso che l’intelligenza artificiale sia come la lama del capitalismo. Si può dire che il capitalismo sia anti umano, mette gli esseri umani gli uni contro gli altri, in particolare le persone che lavorano per guadagnarsi da vivere e quelle che guadagnano denaro perché ne hanno già in partenza. L’intelligenza artificiale è l’arma più recente che il secondo gruppo può usare contro il primo. Toglie l’autonomia e la libertà di scelta alle persone che lavorano per sopravvivere, al fine di arricchire chi non lavora. Se vogliamo che ogni individuo abbia autonomia e libertà di scelta, invece che solo i ricchi, dovremmo resistere all’intelligenza artificiale».

In una recente intervista ha parlato della difficoltà per l’intelligenza artificiale di raggiungere il libero arbitrio, osservando che animali e bambini ne sono privi, mentre gli adulti lo possiedono. Come possiamo valutare se un’Ia ha una coscienza o possiede il libero arbitrio?

«Per libero arbitrio intendiamo la capacità di assumersi la responsabilità delle proprie azioni. In genere, non puniamo chi non distingue il bene dal male o non ne comprende le conseguenze. Ecco perché non riteniamo gli animali o i bambini legalmente responsabili delle loro azioni; lo facciamo solo per gli adulti con piena capacità mentale. Questo non è rigoroso al cento per cento: pochi, infatti, pensano che il cambiamento avvenga esattamente al compimento dei 18 anni. Tuttavia, per praticità dobbiamo pur tracciare un limite, una linea, da qualche parte. Questo vale sia che l’universo sia deterministico o meno. Seguendo lo stesso ragionamento, non possiamo dire che un software abbia libero arbitrio, a meno di ritenerlo legalmente responsabile delle proprie azioni, e ciò non ha senso, non si può punire un programma di video scrittura. Credo, dunque, che qualsiasi argomentazione secondo cui dovremmo ritenere il software responsabile delle sue azioni sia meglio interpretabile come un tentativo da parte delle aziende informatiche di eludere le proprie responsabilità».

La locandina ufficiale del firm Arrival tratto dai racconti di Chiang. Crediti: Mymovies.it

Nel suo romanzo Il ciclo di vita degli oggetti software esplora come gli esseri artificiali evolvono da semplici programmi informatici a entità auto coscienti. Pensa che la convivenza con le intelligenze artificiali avanzate possa cambiare la nostra idea su cosa significhi “essere umani”?

«Credo che la sfida più grande alla nostra comprensione di cosa significhi essere umani sia già avvenuta in passato. Coincide con il momento in cui si è accettato il fatto che gli esseri umani sono fatti di materia e non hanno anime immateriali. Non tutti lo accettano, e non credo che l’Ia ci farà cambiare idea su questo. Molti temevano che questa consapevolezza del “non avere un’anima” avrebbe spinto le persone ad agire male, e alcuni, nel farlo, l’hanno effettivamente usata come giustificazione. Ma le persone si comportavano male anche quando si credeva nell’anima immortale. Si troveranno sempre argomenti per fare ciò che si vuole. Se alcuni pensano che l’Ia dia loro il diritto di nuocere agli altri, lo faranno senza problemi. Si può tuttavia scegliere di agire con rispetto e dignità, anche senza credere nell’anima. Nessuno sviluppo tecnologico ci impedirà di prendere liberamente questa decisione, né ci assolverà se non lo faremo».

Guarda il trailer del film Arrival: