L’aveva detto la scorsa estate in un’intervista a Media Inaf che i sistemi cyborg – dove una parte del lavoro viene fatta da una macchina e un’altra parte da un umano – rappresentano il futuro per l’analisi di grandissime quantità di dati astronomici. Ora Kevin Schawinski, del Politecnico federale di Zurigo (Eth) e co-fondatore del sito di scienza partecipata Galaxy Zoo, mette la prima firma a un articolo in via di pubblicazione su Monthly Notices of the Royal Astronomical Society che rappresenta un passo avanti proprio in questa direzione.

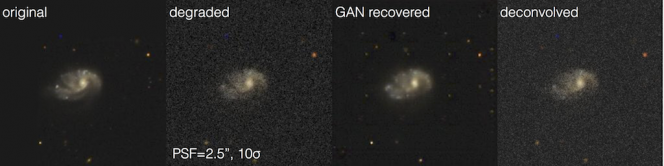

Utilizzando innovative tecniche basate su reti neurali, ovvero software che simulano il funzionamento del cervello umano, Schawinski e colleghi sono riusciti ad aumentare la definizione di immagini astronomiche di galassie, oltre il limite finora raggiunto dagli algoritmi di deconvoluzione, che ricostruiscono i pezzi mancanti dell’immagine su base statistica.

I ricercatori hanno istruito una rete neurale sull’aspetto di una generica galassia, chiedendo poi a questa macchina software di tentare di recuperare un’immagine appositamente sfuocata di una galassia, rendendola di nuovo nitida. Proprio come un essere umano, per imparare il “concetto” la rete neurale ha bisogno di esempi, in questo caso costituiti da coppie di immagini, una nitida e una sfuocata, della stessa galassia.

Questi fotogrammi sono un esempio di come si è svolto lo studio: l’immagine originale della galassia originale (a sinistra), la stessa immagine volutamente degradata (secondo da sinistra), l’immagine dopo il recupero con la rete neurale (seconda da destra) e, infine, l’immagine elaborata con la migliore tecnica di deconvoluzione esistente (a destra). Credito: K. Schawinski / C. Zhang / ETH Zurigo

Il sistema utilizzato nel nuovo studio usa un recentissimo approccio che mette due reti neurali in competizione l’una con l’altra, chiamato generative adversarial network (Gan), che potremmo tradurre con “rete antagonista generativa”. L’intera fase di apprendimento da parte della “macchina”, spiegano gli autori, ha richiesto solo poche ore di calcolo su un computer ad alte prestazioni.

Schawinski vede questo risultato come un grande passo in avanti, grazie al quale si potranno riprendere in mano i campionamenti di cielo già realizzati e rendere migliori le immagini ottenute, scoprendo dettagli che in passato non emergevano. Secondo lo scienziato, «non c’è alcun motivo perché poi non si possa applicare questa tecnica per le immagini più lontane riprese da Hubble, nonché dal futuro telescopio spaziale James Webb, per saperne di più sulle prime strutture comparse nell’universo».

«I sistemi basati su reti neurali artificiali sono alternativi a quelli tradizionali dell’intelligenza artificiale, il cui approccio simbolico indaga una mente artificiale indipendentemente dal suo supporto fisico», spiega Andrea Baraldi, esperto di visione artificiale al Dipartimento di geoinformatica dell’Università di Salisburgo consultato da Media Inaf. «Le reti neurali applicate alla computer vision per la segmentazione semantica delle immagini e la classificazione delle scene si sono dimostrate capaci di trasferimento di conoscenza: quando istruite su un campione di immagini, possono analizzare con successo il successivo campione senza, o con minore, bisogno di essere nuovamente istruite».

«Tuttavia», prosegue Baraldi, «il problema di migliorare la nitidezza delle immagini astronomiche con la computer vision appartiene al dominio multi-disciplinare delle scienza cognitive, dove la questione centrale diventa come trasferire conoscenza preliminare acquisita da esseri umani alle macchine, in generale, e ai sistemi di elaborazione distribuiti, in particolare».

«Il rischio è sempre quello di pretendere che un problema cognitivo sia semplice. Al contrario i problemi cognitivi, come il processo di visione, sono i più complessi che ci siano, e pretendere di renderli semplici vuol dire, in pratica, sottostimarne la complessità», conclude Baraldi.

Per saperne di più:

- Leggi l’anteprima dell’articolo in pubblicazione su MNRAS “Generative Adversarial Networks recover features in astrophysical images of galaxies beyond the deconvolution limit”, di Kevin Schawinski, Ce Zhang, Hantian Zhang, Lucas Fowler e Gokula Krishnan Santhanam

Guarda l’intervista di Inaf-Tv a Kevin Schawinski a Manchester (UK) in occasione di Esof 2016 (in inglese, abilitare i sottotitoli in italiano):